ゲーム系コミュニケーションサービス「Discord(ディスコード)」が2月24日、未成年保護を目的に世界展開を進めている「年齢確認」の導入について、当初予定していた3月から2026年後半へ延期すると発表しました。

年齢確認の対象は限定的だと説明していたものの、顔認証や身分証提出が広く義務化されるのではないかとの懸念が広がったことを受けての対応です。

■ 9日の安全強化策、広がった不安

発端となったのは、今月9日に公表された「未成年向け安全対策」の強化策です。

初期設定の段階で、全ユーザーに対し未成年向けの「デフォルト安全設定」を適用し、「年齢制限のあるコンテンツへのアクセス」や「安全設定の変更時」に限って年齢確認を求める仕組みを導入すると発表していました。

成人かどうかの判定は、多くのケースで「年齢“推定”」技術を用い、アカウント作成からの期間や支払い方法の登録状況、利用パターンなどの情報を基に自動で判断すると説明。

また、推定できなかった場合に限り、外部事業者が提供する年齢確認手段を利用するとし、確認に用いたデータは最小限にとどめ、速やかに削除するとしていました。

しかしSNS上では、「顔認証が義務化されるのではないか」「個人情報を広範に収集されるのではないか」といった懸念が相次ぎました。仕組み自体は説明されていたものの、不安を払拭するには十分ではなかったようです。

背景には、2025年10月に発表された情報漏えい事案があります。カスタマーサポートの委託先企業が不正アクセスを受け、約7万人分のユーザー情報が流出したとされる問題です。

セキュリティへの不安がなお残るなかで新たな認証手法が打ち出されたことが、ユーザーの疑念を一層強める一因になったとみられます。

■ 「90%以上は年齢確認を行う必要はありません」強調、仕組みを再説明

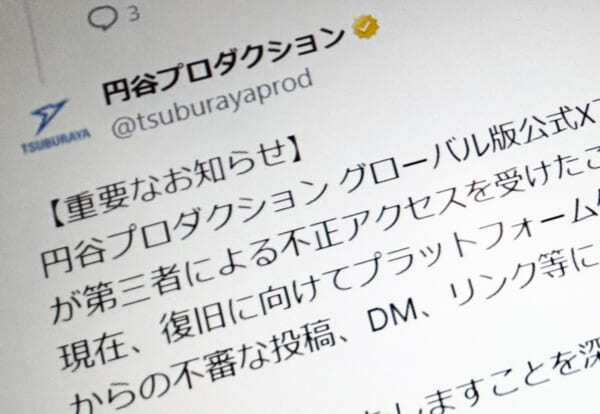

24日に公開されたDiscordの公式ブログで、共同創業者兼CTOのスタニスラフ・ヴィシュネフスキー氏は、9日の発表について「説明が十分ではなかった」と認めました。

顔認証や身分証の提出が全ユーザーに義務付けられるかのように受け止められた点にも触れ、「90%以上のユーザーは、これまで通りDiscordを利用するために年齢確認を行う必要はありません」と強調しました。

あわせて「年齢推定」の仕組みを改めて説明。判定にはアカウント単位の情報を用いるとし、「メッセージの内容を読むことや、会話を分析すること、投稿内容を確認することはありません」と明言。

内部システムで成人確認ができない場合に限り、外部事業者による年齢確認を実施するとしています。事業者がDiscordに返すのは年齢区分のみで、本人の身元情報は共有されない設計です。

外部事業者との連携についても透明性を強化する方針を示しています。提携先の名称やデータ取り扱い方針を公式サイトおよびアプリ内で明示するほか、顔による年齢推定を採用する場合は、データ処理を端末内で完結させることを必須条件としたとしています。英国で実施したテストでは、この基準を満たさなかった事業者について採用を見送ったことも明らかにしました。

さらにDiscordは、コミュニティからの意見を受け、新機能の一部を見直す考えも示しています。年齢制限チャンネルを設ける理由が必ずしも成人向けコンテンツとは限らず、ネタバレや政治的話題などを「自分の意思で閲覧したい」という用途もあることを踏まえ、年齢制限とは別に「スポイラーチャンネル」の新設を進めるとのこと。

なお、英国やオーストラリアなど、すでに法的に年齢確認が義務付けられている国・地域では、引き続き承認済み手法による確認が必要になります。

■ 延期の背景に残る不信感

未成年保護の強化は世界的な潮流ですが、同時に「どこまでが安全対策で、どこからが監視なのか」という線引きは利用者にとって敏感な問題です。

今回の一連の反応は、プラットフォームに求められる透明性の水準が確実に上がっていることを示しました。

Getting Global Age Assurance Right: What We Got Wrong and What’s Changing.

Read the update: https://t.co/h7aRGmN7xW

— Discord (@discord) February 24, 2026

<参考・引用>

Discord「Getting Global Age Assurance Right: What We Got Wrong and What’s Changing」

Discord(@discord)