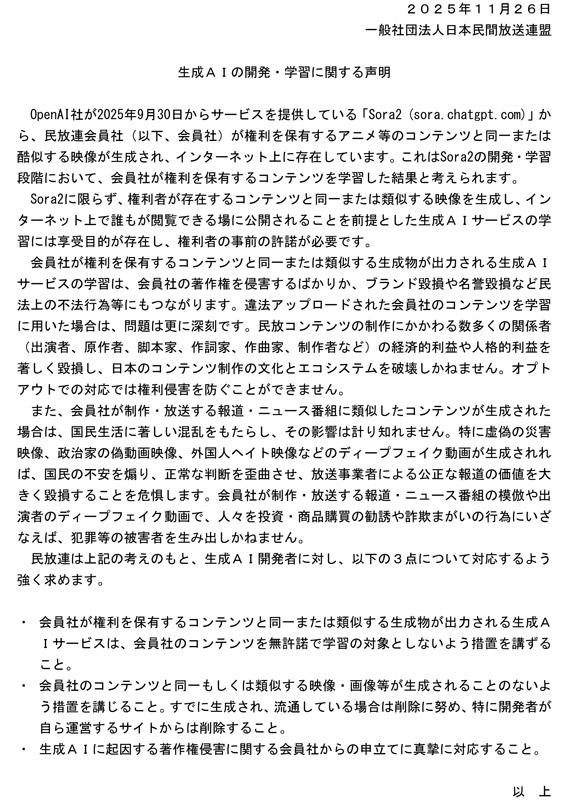

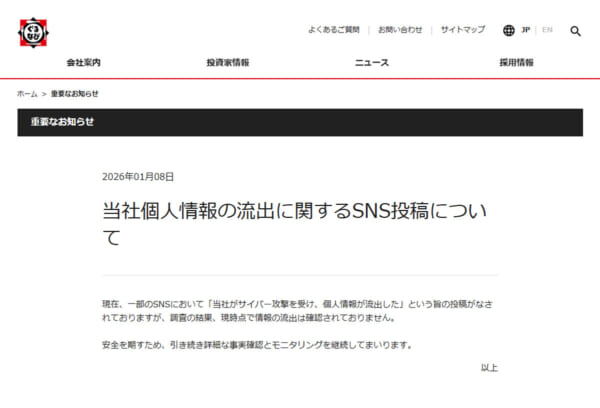

一般社団法人日本民間放送連盟(民放連)は11月26日、「生成AIの開発・学習に関する声明」を発表しました。OpenAIが提供する映像生成AI「Sora2」によって生成された、会員各社が権利を持つアニメ作品などと酷似する映像が、インターネット上に存在していることが背景にあるとしています。

民放連は、こうした事例はSora2の開発・学習過程で会員社のコンテンツが無断で学習に使われた結果だとみており、著作権や各種権利を侵害する深刻な問題だと警告しました。

■ 生成AIの学習と著作権をめぐる懸念

声明によると、権利者が存在する映像作品と類似するコンテンツを生成し、誰もが閲覧できる形で公開することを前提としたAIの学習には「享受目的」があるため、権利者の事前許諾が必須だと指摘。無断で学習に用いることは著作権侵害となるだけでなく、ブランド毀損や名誉毀損を招き得る民法上の不法行為にも該当するとしています。

特に、違法にアップロードされたコンテンツを学習に使った場合、その影響はより重大だとし、出演者・制作者・原作者など、多数の関係者の利益が損なわれ、日本のコンテンツ文化や制作エコシステムそのものを破壊しかねないと強い懸念を示しました。学習拒否を示す「オプトアウト」だけでは、権利侵害を防ぐ仕組みとして不十分だとも述べています。

また、会員社が制作・放送する報道番組やニュース番組に酷似した映像が生成された場合、国民生活への混乱は避けられないと強い懸念を表明。

特に災害報道や政治家の発言などを模した虚偽映像、外国人ヘイトを助長するディープフェイク動画などが拡散すれば、社会不安を煽り、正確な判断を妨げ、公正な報道の価値を大きく損なうと指摘しています。

さらに、番組出演者の偽動画が投資勧誘や詐欺的行為に悪用される可能性にも触れ、実害が発生する危険性を強調しました。

民放連は生成AIの開発者に向け、「会員社のコンテンツを無許諾で学習に利用しない措置を取ること」、「同一または類似する映像が生成されないよう技術的対応を講じ、すでに生成されて流通しているものについては削除に努めること」、そして「著作権侵害に関する申立てに真摯に対応すること」の三点を強く求めています。

■ 学習データ問題と偽映像がもたらす社会的リスク

声明は、急速に普及する生成AIと既存の著作権制度との間に生じているギャップが表面化するなか、放送事業者としての立場を明確にする狙いがあるとみられます。

背景には、AI開発が世界的競争のもとで加速する一方、学習データの管理や権利処理のルールがサービスごとに統一されないまま、技術だけが先行してきたという構造的な事情があります。

とりわけ放送業界では、番組アーカイブや映像素材を厳格に管理し、外部利用には明確な許諾が必要とされてきました。しかし生成AIの学習では、こうした前提が共有されないケースがあり、無断利用の懸念が高まっています。

また放送は公共性の高いメディアであり、特にニュース報道は“信頼”を基盤として成立しています。放送局の画面構成や演出に似せた偽映像や架空のニュースが出回れば、その影響は従来よりも深刻になりかねません。

さらに現在は、SNS上で真偽不明の映像が瞬時に拡散する環境が整っており、情報の混乱が起きやすい状況にあります。今回の声明は、単に特定サービスの問題を指摘するだけでなく、放送の信頼性を揺るがす環境変化そのものに対して、業界として警鐘を鳴らす意味合いを持つと言えるでしょう。

<参考・引用>

一般社団法人日本民間放送連盟:「生成AIの開発・学習に関する声明」について(11月26日)